1. 서 론

프리팹 강구조물(PSS: Prefabricated Steel Structures)은 지속가능성과 환경 친화적 설계, 혁신적인 기술 및 재료, 디지털 기술의 통합 등의 측면에서 중요성을 인정받고 있으며, 그 수요가 증가하고 있다(Chen et al., 2020). 다만 PSS 구조물의 특성상 설계 및 제작과정에서 발생하는 오차는 조립여부 및 전체 구조물의 안정성에 지대한 영향을 미칠 수 있기 때문에 구조물의 형상 성능을 효과적으로 계측하고 분석하는 것은 중요하다. Wang 등(2020)은 공장에서 생산되는 결함이 있는 건설 부재를 처리하는 데 소요되는 비용이 전체 생산과정에 수반되는 비용의 60%를 차지함을 보고한 바 있으며, 국토교통부의 강구조 공사 표준시방서(Ministry of Land, Infrastructure and Transport, 2016a)에 따르면, 강구조물 제작 시 볼트 그룹 내의 볼트 간의 최대연단 거리의 오차를 ±2mm 이하로 규정하고 있는 만큼 안정성과 사용성 확보를 위해서는 설계 시 이를 고려해야 한다.

PSS를 포함한 건설 부재의 형상 성능 판단을 위하여 현재까지는 작업자가 줄자와 같은 간단한 측정장치를 이용하여 경험 기반의 형상 성능 판단을 수행하고 있다(Seo et al., 2023). 그러나 이러한 방식은 작업자에 따른 편차가 발생할 뿐 아니라, 매 계측마다 작업환경의 온도에 따른 부재 구성재료에서의 수축과 팽창으로 인한 계측 오차 발생 소지가 있다(Wang et al., 2021). 따라서, 최근에는 비접촉식 센서인 레이저 스캐너, 라이다(LiDAR; Light Detection And Ranging), 비전 센서 등을 활용하여 형상 성능을 판단하는 연구가 진행되어 왔다(Cha et al., 2019; Kim et al., 2015; Lee et al., 2023). Kim 등(2015)은 BIM(building information modeling)과 3D 레이저 스캐너를 이용하여 프리캐스트 콘크리트의 구성요소에 대한 종단간(end-to-end) 형상계측 프레임워크를 제안하였다. Cha 등(2019)은 라이다 기술의 한 형태인 TLS(Terrestrial Laser Scanning)를 이용하여 데이터 손실을 최소화하고 처리 효율을 제고하면서 교량 구조물의 변형 및 처짐을 모니터링하는 형상 정보 모델(shape information model)을 제시하였다. Lee 등(2023)은 비전 센서를 이용하여 서브 밀리미터 수준의 정확도와 표면 반사와 같은 시각적 한계 등을 처리하는 이미지 기반의 3D 재구성 기법을 제시하였으며, 표면에서 반사가 발생하는 알루미늄 관과 프리팹 콘크리트 기둥에 이를 적용함으로써 형상계측을 수행하였다. 특히, 3D 레이저 스캐너는 접촉식 센서와 비교하였을 때, 상대적으로 먼 거리에서 측정이 가능할 뿐 아니라, 밀리미터 수준의 정확도를 보장한다(RIEGL Inc., 2024). LiDAR 역시 계측 범위가 넓고, 초당 수십만개의 포인트 클라우드 데이터를 획득할 수 있으며, mm 수준의 상대 정확도를 보이는 장점이 있으나 가격이 비싸다는 한계점이 있다(GeoSLAM Ltd., 2024).

Bang 등(2022, 2023)은 비전센서 및 기계학습을 기반으로 한 볼트홀 검출 및 조립성 평가 기법을 개발하였다. 딥러닝 기법을 적용하여 조립부 영역을 검출(segmentation)하고, 영상의 색 변환, 엣지 및 원형의 볼트홀 검출 등의 영상처리 알고리즘을 적용하여 볼트홀의 중심을 검출한다. 이후 각 볼트홀 간의 간격을 기반으로 k-근접이웃과 같은 기계학습 기법을 적용하여 조립성능(양・불량)을 평가한다. 가격이 저렴한 비전센서를 바탕으로 90% 이상의 높은 정확도를 갖는 조립성능 평가 기술이지만, 조립부 영역의 형태에 따라 좌표축을 통일 및 볼트홀 위치 검출 정확도가 달라질 수 있다는 한계점이 있다.

스테레오 비전 기반의 뎁스 카메라(depth cameras)는 비용이 저렴하면서도 정밀도가 상대적으로 높아 값 비싼 레이저 스캐너와 라이다 센서에 대한 대안으로서 부상하고 있다(Khoshelham and Elberink, 2012). 인간의 시각기관을 모방하여 두 개의 카메라로부터 획득한 이미지 정보를 이용(Vasil’ev, 1995)하여 해당 물체까지의 깊이 정보를 계측하는 스테레오 비전센서 기술은 높은 측정 정밀도와 비접촉식 측정 능력으로 인해 생산 공정에서의 오차 감지에 있어 효과적인 해결책으로 기대된다. 이러한 스테레오 비전센서 기술은 복잡한 구조물의 형상과 치수를 신속하고 정확하게 측정할 수 있으며, 이를 통해 제작 오차를 실시간으로 감지하고 분석하는 데 필요한 데이터를 제공할 수 있다.

본 연구에서는 스테레오 센싱기반의 포인트 클라우드 정보를 활용한 구조물 내 조립부의 3차원 형상 계측 기법을 제시한다. 또한, 국토교통부의 도로교표준시방서(Ministry of Land, Infrastructure and Transport, 2016b)에서 명시하고 있는 허용오차를 준수하여 1/5 스케일을 반영하여 실제 조립식 철골 구조물에 대한 모형을 제작하고 그 성능을 검증하고자 하였다. 제작한 모형의 조립부를 스테레오 비전센서로 촬영하여 볼트홀 간의 거리 측정을 위한 영상 데이터를 수집하였으며, 볼트홀의 검출을 용이하게 하고자 수집된 영상에 대한 전처리 과정을 수행하였다. 이러한 전처리 과정으로서 처리해야 할 데이터의 양을 급격하게 줄이면서도 경계에 대한 구조적인 정보를 보존해주는 퍼지(Fuzzy)논리 기반의 엣지 검출 알고리즘을 적용하였다(Canny, 1986). Fuzzy Logic을 통한 전처리 과정 이후, 전처리된 영상 내에서 볼트홀의 검출을 위하여 원형 호프 변환(Circle Hough Transform, CHT) 알고리즘을 적용하였다(Duda and Hart, 1972).

산출된 이미지의 볼트홀의 위치 정보를 기반으로 볼트홀 외곽선 위 세 점의 위치 정보를 계산하였으며, 이러한 세 점의 위치 정보를 통해 스테레오 비전센서로 녹화한 뎁스 영상으로부터 재구성된 포인트 클라우드데이터를 ZED API를 이용하여 실세계 위치(world coordinate) 정보로 변환한 다음, 해당 지점들의 3차원 좌표를 추출하였다. 추출된 3차원 좌표들 정보를 바탕으로 주성분 분석(Principal Component Analysis , PCA) 알고리즘을 적용하여 좌표축을 정렬하였으며, k-평균 클러스터링 알고리즘을 적용하여 밀집된 포인트 클라우드 정보 내 조립부 볼트홀 영역의 3차원 위치를 계산하였다. 유클리디안 거리를 기반으로 볼트홀 사이의 거리를 계산하여, 그 오차를 분석하였다. 분석 결과로 중앙값 기준 각각 1mm, 4%이내의 절대 및 상대 오차 값을 갖으며 최대 2mm, 7% 이내의 절대 및 상대오차를 보임을 확인하였다.

2. 영상 및 포인트 클라우드 기반의 3차원 거리 계측 알고리즘 개발

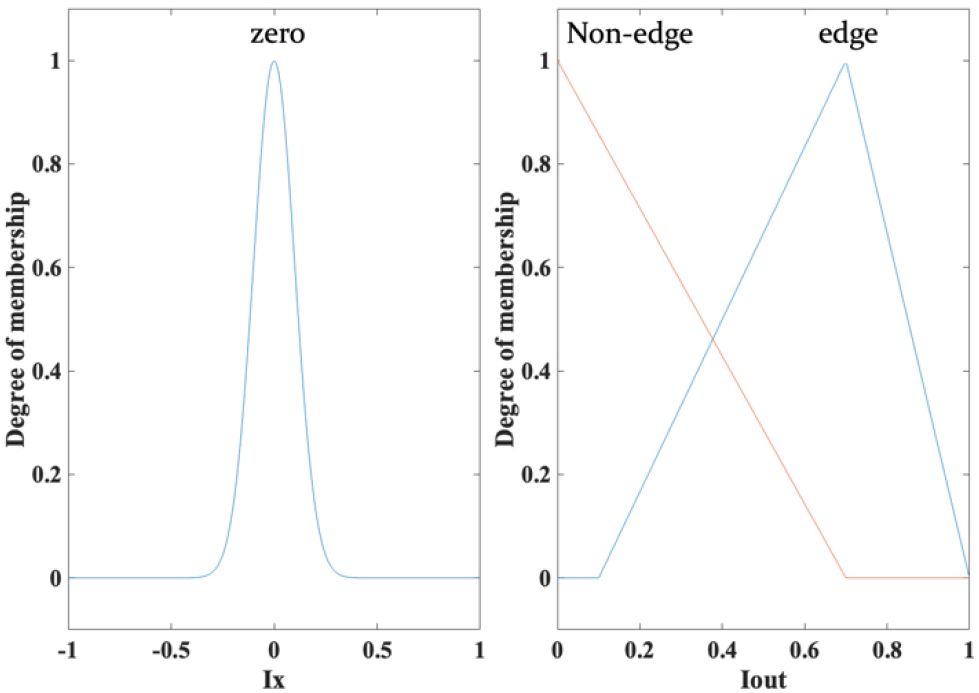

Fig. 1에서 보는 바와 같이 스테레오 비전의 좌・우 영상 및 포인트 클라우드 정보를 이용하여 조립부 볼트 홀 간의 3차원 거리정보를 계산하도록 하였다. 퍼지 논리 알고리즘은 이후 적용할 원 검출 알고리즘인 CHT(Circle Hough Transform)와 서로 결합된 형태인 FCHT(Fuzzy Cell Hough Transform)를 적용하였을 때, 일반적인 원 검출 알고리즘 적용 대비 14~32% 가량 성능 향상이 있음이 보고되었다(Chatzis and Pitas, 1997). 본 논문에서는 수집한 영상에 대한 전처리 과정으로 퍼지 논리 알고리즘을 적용함으로써 안정적으로 볼트홀을 검출하고자 하였다(Fig. 1(b)). 이때 퍼지 논리의 멤버십(membership) 함수의 형태는 Fig. 2와 같고, 퍼지 규칙은 다음과 같다.

- 만약 IX와 IY가 모두 0이라면, Iedge는 거짓이다.

- 만약 IX 혹은 IY가 0이 아니라면, Iedge는 참이다.

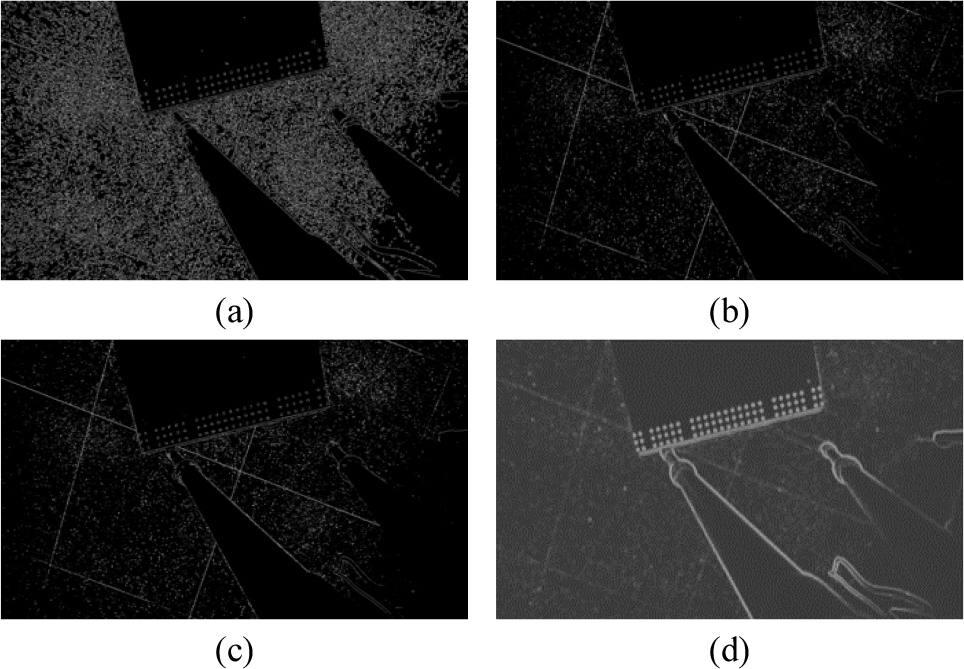

여기서, IX , IY는 x 및 y축 방향의 영상 그래디언트(Gradient)를 의미하며, Iedge는 이미지의 엣지 존재 여부를 나타낸다. Fig. 3에서 보는 바와 같이 영상의 엣지 검출시 대표적으로 사용되는 Canny, Prewitt, Sobel-Feldman 알고리즘보다 퍼지논리 기반 검출 알고리즘이 볼트홀 특징을 보다 효율적으로 검출함을 확인할 수 있다.

퍼지 논리 적용 이후, 볼트홀의 정보가 부각된 그레이 스케일 영상에 대해 CHT를 적용하여 원 형태의 볼트홀을 검출하였다(Fig. 1(c)). CHT 알고리즘은 이미지 상의 선이나 원을 검출하기 위한 알고리즘으로서, 엣지 맵상의 각 엣지 점들을 매개변수 공간으로 변환한 다음, 매개변수 공간의 히스토그램을 누산기 공간(accumulator space) 상에 도식화함으로써 출력 이미지를 산출해낸다(Chiang, et al., 2011). 볼트홀 위치 기반의 조립부 형상 품질을 판단하기 위하여 CHT 알고리즘 적용 이후의 결과 이미지 상에서 검출된 볼트홀의 위치에 대응하는 뎁스 영상 기반의 포인트 클라우드로부터 정보를 추출하였다. 이때, 볼트홀의 구조적인 특징으로 인하여 포인트 클라우드 데이터가 원활하게 생성되지 않으므로 2차원 그레이 스케일 영상에서 볼트홀 외곽선 위 세 점의 위치에 대한 픽셀 좌표를 계산하였다. 계산된 2차원의 세 점의 위치 정보를 ZED SDK를 이용하여 3차원 실세계 좌표(world coordinate)로 변환하였으며, 변환된 데이터를 통해 각 볼트홀에 대한 3차원 벡터 정보를 계산하였다(Fig. 1(d)). 볼트홀 외곽선 위 세 점의 위치 정보는 먼저 CHT 알고리즘을 통해 검출된 두 개의 볼트홀을 선정하고, 이들 중심에 대한 2차원 픽셀 좌표를 이용하여 두 볼트홀의 중심을 지나는 직선과 볼트홀 간의 교점들을 추출하였다.

이 후, PCA(Principal component analysis, 주성분 분석) 알고리즘을 사용하여 볼트홀의 위치 분포를 파악하고, 이를 종합하여 x 및 y 좌표축을 계산하였다(Fig. 1(e)). PCA 알고리즘은 볼트홀의 3차원 위치정보를 가장 잘 표현하는 좌표축을 계산해낼 수 있는 통계적 기법이다(Sanguansat, 2012). x 및 y 좌표축을 계산함으로써 3차원 위치정보를 예측하고, 센서와 부재 간의 방향이 서로 평행이 아니더라도 즉, 센서의 설치 방향에 상관없이 안정적으로 볼트홀 사이의 거리를 계측하도록 하였다. 각 볼트홀의 x 및 y의 2차원 위치정보를 바탕으로 볼트홀의 순서를 정렬하였으며(Fig. 1(f)), 정렬된 볼트홀의 위치정보를 참조하여 인접한 볼트홀 사이의 x 및 y축 방향 각각에 대하여 앞서 계산한 3차원 벡터 정보에 유클리디안 거리 공식을 적용함으로써 조립부 중심의 형상 정보를 파악한다.

3. 실험 검증

3.1 실험 환경 구축

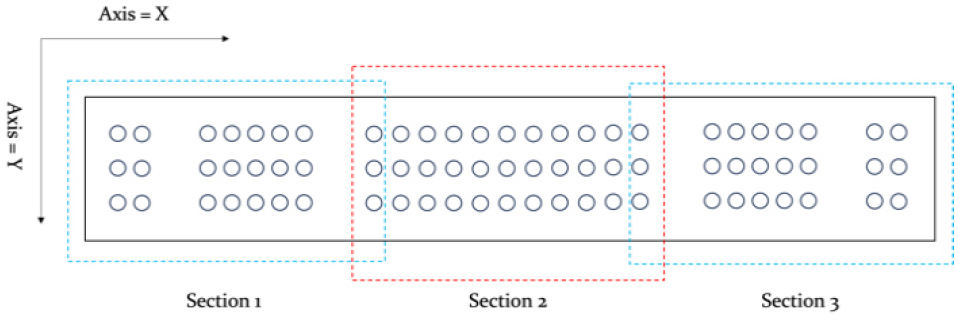

본 연구에서는 Fig. 4와 같이 프리팹 강구조물의 1/5 축소모형을 제작하고, 이를 바탕으로 조립부 형상 계측 실험을 수행하였다. 본 논문에서 사용된 ZED 2i 스테레오 비전 센서는 StereoLabs 사에서 개발한 스테레오 비전 카메라로 2.2K 해상도(4416 × 1242)와 15fps의 성능을 보유하며, IMU, 기압계 및 자력계를 내장하고 있다(StereoLabs Inc., 2024). 이는 초점거리가 2.12mm인 경우 최소 0.3m에서 최대 20m 범위의 깊이 범위(depth range)를 지닌다. 촬영에 앞서 해당 센서와 모형 구조물 사이의 거리를 최소 0.3m 확보한 상황에서 축소모형 연결부의 x 및 y 각 축에 대하여 좌안 렌즈와의 각도가 90°가 되도록 센서를 설치하였다. 해당 센서를 이용하여 축소모형 연결부의 RGB 및 깊이 영상을 촬영하였으며, 정밀도 향상을 위하여 Fig. 5와 같이 세 개의 구역을 나누어 분할 촬영하였다.

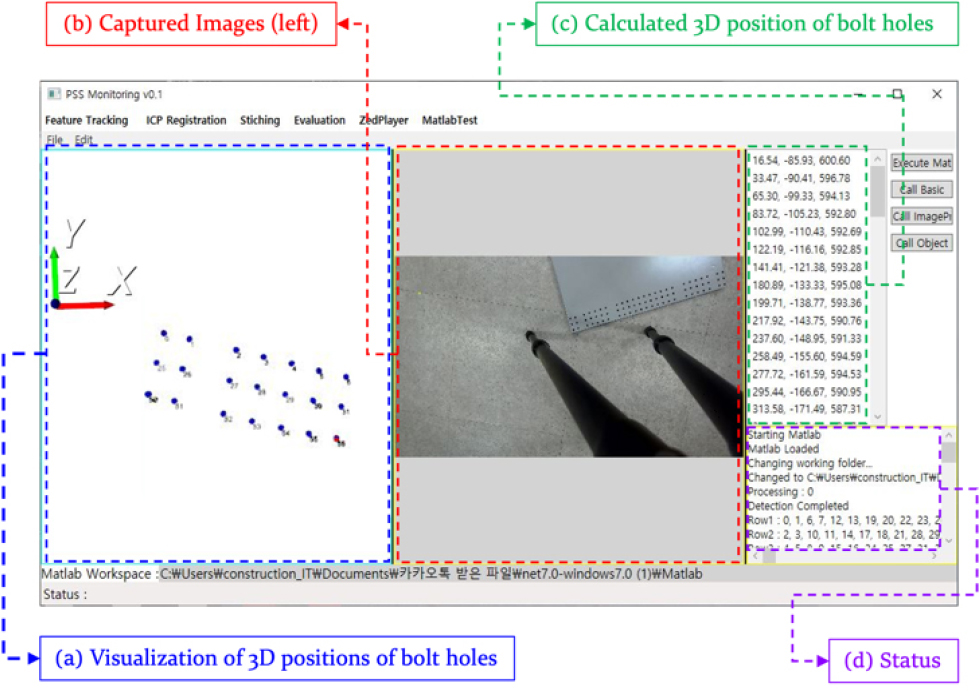

촬영된 영상 정보를 입력하면 볼트홀 간의 거리를 예측하고, 이를 3차원의 형태로 표현하는 소프트웨어를 Fig. 6와 같이 개발하였으며, 예측된 볼트홀 간의 x 및 y축 사이의 거리는 개발 소프트웨어의 모니터링 세션에 표기됨은 물론 별도의 파일에 저장되어 사용자가 이후 분석을 원활히 진행할 수 있도록 하였다. C# 언어 기반의 WPF(Windows Presentation Foundation) UI 프레임워크를 사용하여 개발하였으며, 검출된 볼트홀의 위치 정보를 3D 환경에서 모니터링 할 수 있도록 VTK(Visualization Toolkit) 라이브러리를 활용하여 사용자 인터페이스를 구현하였다. Matlab 프로그램과 연동하여 퍼지기반 영상 색 변환, 엣지 검출 등의 영상처리를 수행할 수 있도록 하였으며, 스테레오 비전의 API(Application Programming Interface)를 활용하여 영상 및 뎁스 정보 기반 각 지점의 3차원 위치를 추출할 수 있도록 구현하였다.

3.2 실험 결과

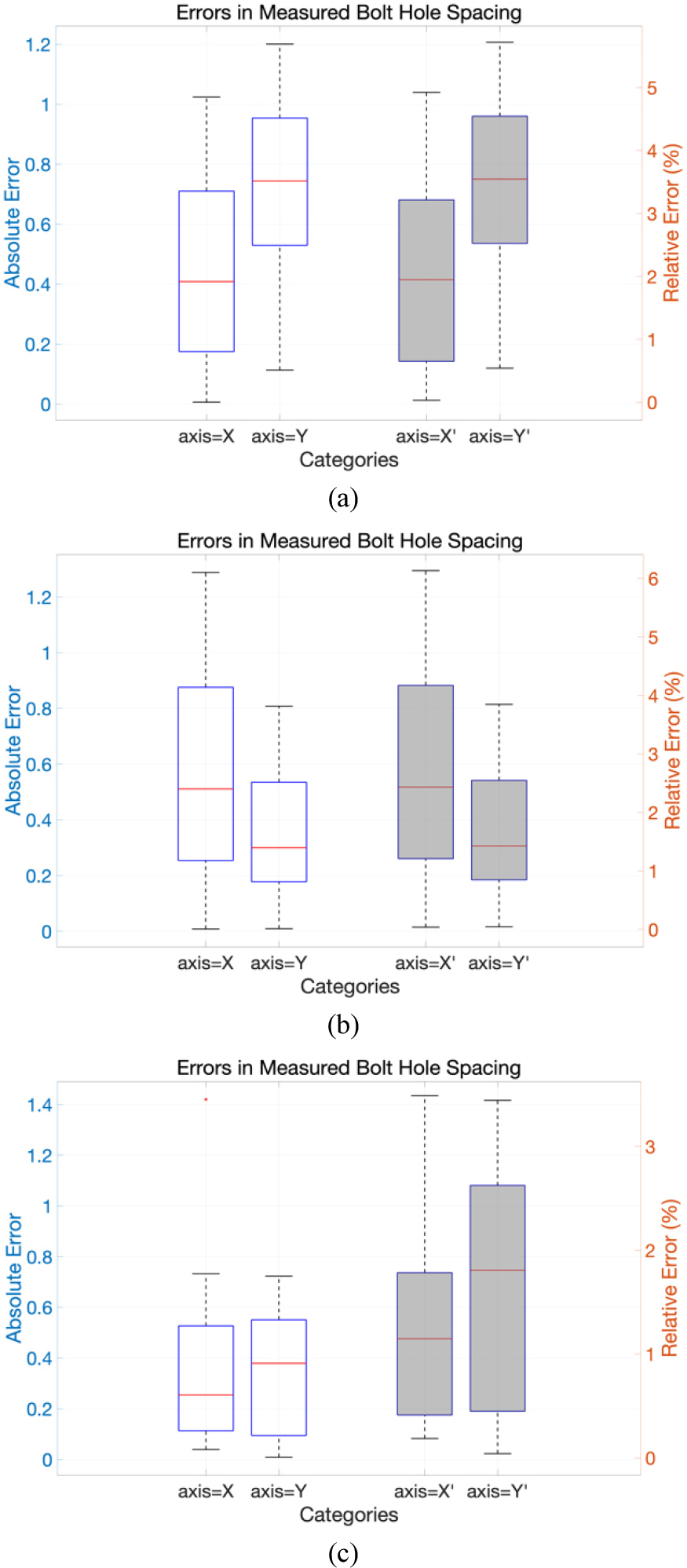

스테레오 비전으로부터 각각의 구역에 대한 x 및 y축 데이터들을 담고 있는 프레임 내에 무한대 혹은 결측치 값들이 존재하는 경우, 이를 제거하고 분석하였다. 전처리 진행 후, 최적의 프레임을 선정하기 위하여 k개의 집합으로 분할해주는 k-평균 알고리즘(k-means Clustering Algorithm)을 적용하였다(Lloyd, 1982; MacQueen, 1967). 해당 알고리즘의 하이퍼 파라미터 k는 3으로 설정하였으며, 밀집된 데이터의 중앙값을 추출하고 해당 거리 값을 선정하였다. 최적 프레임 내에 유의미한 x 및 y축 거리 측정 데이터들에 대하여 실제 거리 측정 데이터들 사이의 절대오차 및 상대오차를 산정하였으며, 식 (1)과 (2)와 같다. 이러한 오차를 상자 수염 그림(box-and-whisker plot)으로 나타낸 결과는 Fig. 7 및 Table 1과 같다.

위 식에서 , 는 각각 절대오차 및 상대오차를, , 은 볼트 홀 사이 간격의 참 값 및 측정값을 의미한다. 모든 구역에 대하여 절대오차의 경우 최대 1.42mm, 상대오차의 경우 최대 6.1%이며, 중앙값 기준으로는 최대 0.74mm와 3.54%의 절대 및 상대오차를 보임을 확인하였다.

Table 1

Quartiles of the absolute and relative errors of the measured distance data for each section

4. 결 론

본 연구에서는 조립식 철골 구조물의 설계와 제작과정에서 발생하는 오차를 비접촉식 스테레오 비전 센서를 이용하여 계측하였다. 실험에 앞서 도로교 표준시방서에 따라 1/5 스케일을 반영하여 축소 모형을 제작하였으며, 제작된 모형으로부터 제안한 방법을 통해 볼트홀 검출을 원활히 진행하였다. 3차원 포인트 클라우드 상에서 볼트홀 위치에 데이터가 누락되는 한계에도 불구하고, 볼트홀 상의 3개의 점을 계산 및 이를 참조함으로써 볼트홀 간의 거리를 3차원 포인트 클라우드 데이터에서 추출해낼 수 있었다. 추출된 데이터들 간 전처리 과정 이후 거리 계산을 진행한 결과, 실제 도면상의 거리와의 절대오차와 상대오차를 비교하였을 때, 각각 최대 1.5mm, 6.5% 이내의 오차를 보임을 확인하였다. 향후 포인트 클라우드 정보의 통계적 품질 분석을 수행하여 그 정밀도를 높이고, 특징점이 부족한 구조물의 형태를 고려한 영상 스티칭 알고리즘을 개발하여 적용 범위를 넓히며, 두 부재간의 형상 기반 조립성능 판단 알고리즘을 개발하고자 한다.