1. 서 론

2. 프리팹 강구조물의 조립 성능 평가 기법

2.1 객체 검출 및 세분화를 위한 딥러닝 알고리즘

2.2 수용 영역 블록 기반의 조립부 검출 네트워크 개발

2.3 k-근접 이웃을 사용한 조립성능 평가 기법

3. 실험 및 검증

3.1 3D 축소 모형을 이용한 실험 환경 구축

3.2 조립부 검출 및 성능 예측 실험 결과

4. 결 론

1. 서 론

출산율의 감소와 인구의 고령화 추세는 노동 가능 인력의 감소를 초래하였고 여기에 더하여 노동 시간 감소를 위한 사회적인 노력이 이루어지고 관련 법령이 제정되면서 건설 산업을 위한 인력 감소는 가속화되고 있다. 특히 숙련된 인력의 감소는 건설 산업 전체의 문제로 대두되고 있다. 이러한 인력의 부족을 해결하기 위해 건설 자동화 및 효율화의 필요성이 대두되고 있으며, 이를 실현하기 위한 방안으로 주목받고 있는 것이 스마트 건설이다. 스마트 건설은 디지털화된 데이터들을 기반으로 IoT(Internet of Things), AI(Artificial Intelligence), 클라우드 컴퓨팅 등의 기술을 사용하여 건축 정보를 모델링하여 통합적으로 관리하고 공정을 모듈화 함으로서 건설 시공 과정의 생산성을 증대하는 것을 목적으로 한다(Štefanič and Stankovski, 2018). 이러한 스마트 건설에서 중요한 요소 중 하나가 모듈화를 통한 바용의 절감과 효율성의 증대이다. 공장에서 사전에 제작되어 현장에서 조립을 수행하는 모듈형 프리팹 구조가 대표적인 사례이다. 이러한 모듈형 프리팹 구조의 사용을 통해 건설에 필요한 기간을 단축할 수 있으며 원자재의 사용을 최적화 하여 효율적인 자원과 에너지의 사용이 가능하여 불필요한 소비를 줄이는 친환경적인 효과도 있어 근래 관련 연구가 활발히 수행되고 있다(Lacey et al., 2018) .

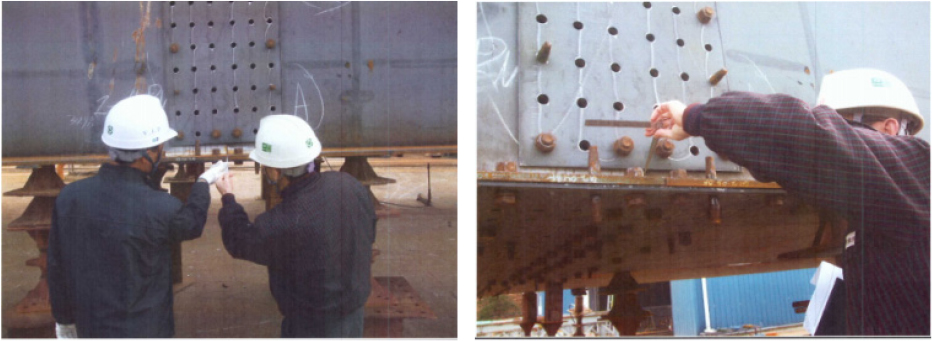

특히 강구조물의 경우 형태를 만들기가 용이하고 조립 방법 역시 다른 재료에 비해 단순하여 모듈형의 프리팹 구조로 교량을 비롯하여 다양한 구조물에서 사용되고 있다. 프리팹 구조물의 제작 및 시공 관리를 위해 국토교통부는 프리팹 강구조물의 경간 중간의 제작 솟음, 볼트 구멍의 허용 오차, 볼트 구멍의 관통율과 정지율 등을 규정하여 관리하고 있다(Ministry of Land, Infrastructure and Transport in Korea, 2013). 프리팹 강구조물의 조립부 제작 오차의 경우 완성된 제작물의 품질과 안전성에 직접적으로 영향을 미치는 요소이므로 제작 및 조립과정에서 안전성을 위한 검사는 필수적이다. 현재 이러한 검사는 프리팹 강구조물의 초기 조립 과정에서 치수와 외부 손상 등에 대하여 조사원에 의해 계측 장비를 사용하여 수행되고 있다(Fig. 1 참조).

프리팹 구조물에 대한 관심이 증가함에 따라 안정성 및 제작 형상의 정밀성을 예측하기 위한 연구들 역시 활발하게 수행되었다. 주로 센서를 이용하여 특정 지점의 변형을 측정하여 효율적인 접합 방법을 제안하거나 레이저 스캔 등의 방법을 사용하여 구조물을 3D로 재구성하는 연구가 수행되었다. 프리팹 구조물의 경우 조립 부분에서 취약한 지점이 발생할 확률이 높기 때문에 조립부의 조립 방식을 개선하거나 모니터링하기 위한 방법들이 제안되었다. Liu 등(2015)은 실험을 통해 프리팹 강구조물 설치 후 지진 등의 외력이 작용하는 경우의 거동을 규명하고 안정성을 향상시킬 수 있는 조립 방법을 제안하였으며, Zhang 등(2019)은 내진 성능을 향상시키기 위한 연결방법을 제안하고 외부 실험을 통하여 그 성능을 검증하였다. 이러한 프리팹 구조물의 조립 방법의 개선에 대한 연구 이외에도 형상 계측의 정밀성을 모니터링하기 위한 연구들도 다수 수행되었다. 주로 3D 스캔을 사용한 방법들이 제안되었는데, Park 등(2007)은 TLS(Terrestrial Laser Scanner)를 사용하여 제작된 구조물의 형상을 3D로 재구축하고 그 형상을 계측하여 모니터링을 수행하였다. Kim 등(2016)은 형상계측을 위해 TLS를 사용하고 계측된 형상 정보를 바탕으로 도면과의 비교를 통하여 조립 성능을 평가하는 방법을 제안하였고, Xu 등(2020)은 3D 스캔을 사용하여 제작된 프리팹 구조물을 포인트 클라우드 형태로 재구성하고 조립부를 추출하여 2차원으로 변환하고, 이를 바탕으로 조립부의 위치정보를 수집하여 도면과 비교하는 방식의 성능 평가 기법을 제안하였다. 3D 스캔을 사용하는 방법 이외에도 Tan 등(2020)은 LiDAR(Light Detection And Ranging)를 사용하여 설치된 프리팹 유닛을 스캔하고 BIM(Building Information Modeling)에 저장된 요소들을 기반으로 조립 성능을 평가하는 방법을 제안하였다.

조립부의 품질은 전체적인 프리팹 구조물의 안정성에 있어 중요한 요소이기 때문에 조립 성능 모니터링은 프리팹 구조물의 시공에 있어 중요한 과정이다. 대부분 3D 스캐너를 사용하거나 LiDAR를 사용하여 형상을 계측하는 방법을 사용하였으나 높은 밀도를 가진 포인트 클라우드의 구축을 통한 평가 방식은 높은 연산량을 요구한다. 또한 3D 스캔을 위한 기기나 LiDAR 기기는 고가의 비용이 요구되기 때문에 실용화 단계에서 어려움이 발생할 수 있다. 이러한 문제를 해결하기 위해 본 논문에서는 비전 센서를 사용한 조립 성능 평가 기법을 제안하였다. 딥러닝 기반의 객체 세분화(segmentation) 기법을 사용하여 조립부를 픽셀 단위로 추출하고 추출된 영역을 기반으로 볼트 홀 등의 특징 점을 추출하여 매개변수를 산정하였다. 산정된 매개변수를 바탕으로 기계학습 기반의 조립 성능을 평가할 수 있는 모델을 구축하여 조립 성능을 평가하는 기법을 제안하였다. 또한 제안된 기법을 검증하기 위해 공장에서 생산되는 프리팹 강구조물의 도면을 기반으로 3D 축소 모델을 제작하여 제안된 조립 평가 기법의 성능을 검증하였다.

2. 프리팹 강구조물의 조립 성능 평가 기법

본 논문에서 제안하는 프리팹 강구조물의 조립 성능 평가 기법은 두 가지 단계로 구성되어 있다. 첫 번째는 구조물이 연결되는 조립부를 검출하는 단계이다. 검출 모델을 구축하기 위해 관련 영상을 수집하고 딥러닝 기반의 모델을 학습하여 조립부 검출을 수행하였다. 두 번째는 검출된 조립부를 추출하여 조립 성능 평가를 수행하는 단계이다. 영상처리 기법을 사용하여 조립부 내의 볼트 홀의 좌표를 탐색하여 이를 바탕으로 조립 성능 평가를 위한 변수를 추출하고 k-근접 이웃 분류기를 사용하여 조립 성능(양・불량)을 평가하였다.

2.1 객체 검출 및 세분화를 위한 딥러닝 알고리즘

컴퓨터의 하드웨어 발전에 따른 연산 능력의 향상과 다양한 형태의 네트워크가 개발되면서 딥러닝은 데이터가 존재하는 모든 분야에서 분석을 위한 유용한 도구로써 사용되고 있다. 영상을 대상으로 하는 컴퓨터 비전 분야에서는 합성곱 신경망(Convolution Neural Network, CNN)이 등장하여 기존의 영상처리 기법에 비해 영상 분류(Classification), 객체 검출(Object detection)이나 세분화(Segmentation) 등의 분야에서 좋은 성능을 보여주면서 다양한 분야에 응용되게 되었다. 합성곱 신경망은 일정한 높이와 너비를 가지는 필터를 사용하여 특정 간격으로 이미지를 구성하는 픽셀 값의 행렬을 통과하면서 합성곱 연산을 수행하여 특성맵(feature map)을 출력하는 합성곱층(Convolution layer)과 합성곱층에서 출력된 결과를 압축하여 특징의 추출을 용이하게 하고 연산량을 줄이는 역할을 하는 풀링층(Poolig layer)이 조합되어 구성되는 네트워크로 영상과 같이 행렬로 구성된 데이터에 사용하여 데이터의 특성을 추출하는 용도로 주로 사용된다. 합성곱 신경망을 사용한 딥러닝은 1,461,406개의 이미지 중 1,000개의 범주로 분류를 수행하며 성능을 경쟁하는 ILSVRC(ImageNet Large Scale Visual Recognition Challenge) 대회에서 2012년에 AlexNet이 우승을 차지하면서 주목받기 시작했다(Russakovsky et al., 2015). AlexNet은 5개의 합성곱층과 풀링층으로 이루어진 신경망과 두개의 층을 구성하는 모든 뉴런이 연결된 형태를 가지는 완전 연결 계층(Fully Connected layer) 3개로 구성된 신경망을 결합하여 네트워크를 구성하였다(Krizhevsky et al., 2012). 이전의 ILSVRC대회에서 좋은 성적을 보였던 알고리즘들이 영상처리 기법을 사용하거나 합성곱 신경망을 사용하는 경우에도 1~2개의 적은 층을 사용한 것에 반해 AlexNet의 경우 5개의 합성곱층을 연결하여 상대적으로 깊은 네트워크를 구성하여 딥러닝의 가능성을 보여주었다. AlexNet이 우승을 차지한 후 ZFNet과 같은 합성곱 신경망 기반의 딥러닝 네트워크들이 등장하기 시작하였고 2014년에 인간의 분류 오차인 5%에 근접한 오차율인 7% 내외의 오차율을 보이면서 GoogLeNet과 VGGNet이 각각 우승과 준우승을 차지하면서 딥러닝은 영상 인식 및 처리분야에서 독보적인 성능을 보여주며, 다양한 분야에 응용되기 시작하였다(Russakovsky et al., 2015).

영상 내에서 특정한 객체의 존재 유무를 판단하고 분류하는데 더하여 그 물체가 존재하는 영역을 특정하는 객체 검출과 객체의 위치를 픽셀단위로 검출하는 세분화를 위한 네트워크가 개발되어 다양한 분야에 적용되었다. 특히 픽셀단위로 특정 범주의 물체가 존재하는 영역을 검출하는 물체 세분화(Instance Segmentation)를 위한 네트워크들이 개발되었다. 기존에 존재하는 객체 검출을 위한 네트워크를 사용한 모델로는 Mask RCNN(Region-based CNN)이 있다. 객체 검출에 사용되는 Faster RCNN의 경우 네트워크 앞 단의 CNN 구조를 통하여 영상의 특징들을 추출하고 객체가 존재할 가능성이 있는 후보 영역을 특정 크기의 앵커를 기반으로 탐색을 수행하는 RPN (Region Proposal Networks)을 사용하여 검출한다(Ren et al., 2015). Mask RCNN은 Faster RCNN의 RPN에서 검출된 후보 영역에 대한 정보를 바탕으로 픽셀 단위로 객체의 마스크(Mask)를 검출하는 단계를 추가하여 물체 세분화를 수행하는 네트워크를 구축하였다(He et al., 2017). 기존에 존재하는 객체 검출 모델을 사용한 네트워크가 아닌 객체 세분화를 위한 네트워크로 합성곱층과 풀링층으로 구성된 인코더(Encoder)를 활용하여 영상의 특징을 추출하여 압축한 후 업샘플링(Upsampling)을 통해 압축된 영상을 기존 크기로 다시 복원하는 디코더(Decoder)를 활용하여 네트워크를 구축한 FCN(Fully Convolutional Networks)이 제안되었다(Long et al., 2015). FCN의 경우 인코더에서 영상의 정보가 압축되는 과정이 존재하는데 이 과정에서 객체 주변의 배경 정보가 손실되는 경우가 발생한다. 이런 문제를 방지하기 위해 같은 크기를 가지는 인코더의 정보를 디코더에 전달하는 연산을 추가하여 영상 세분화 모델의 성능을 개선한 U-net이 제안되기도 하였다(Ronneberger et al., 2015).

2.2 수용 영역 블록 기반의 조립부 검출 네트워크 개발

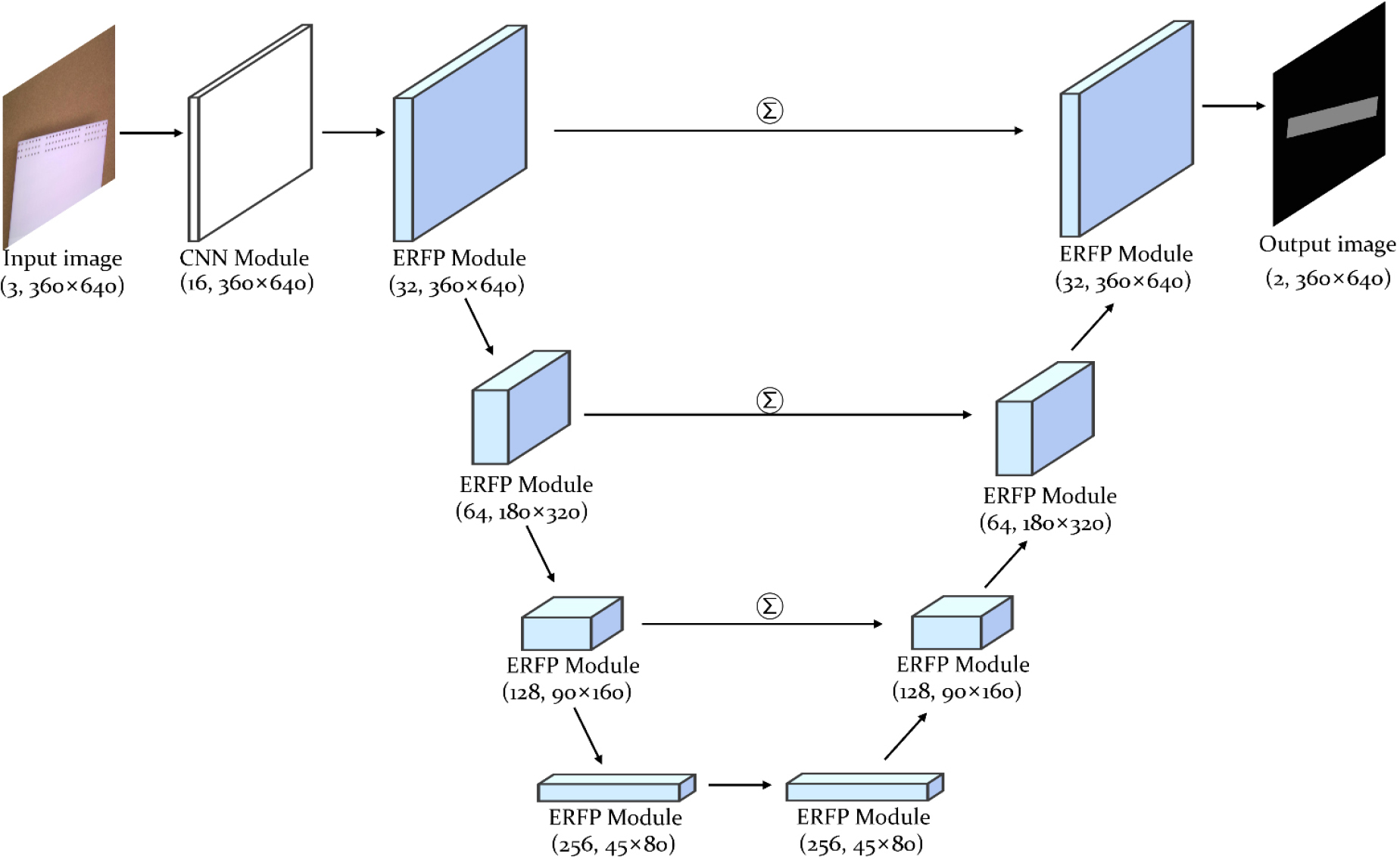

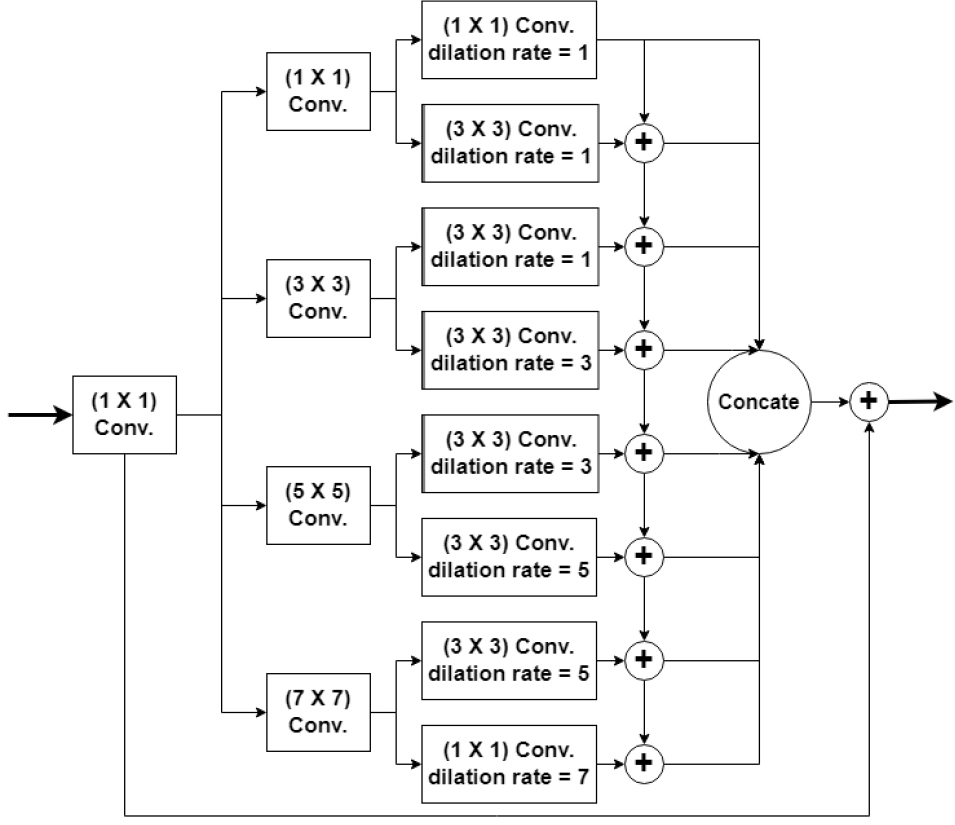

본 논문에서는 프리팹 강구조물의 조립부를 효율적으로 검출하기 위해 인코더와 디코더 형식의 FCN을 기반으로 하여 같은 단계의 인코더와 디코더 사이에 정보를 전달하는 연산을 추가한 U-net의 방법을 적용하여 물체 세분화 네트워크를 구축하였다(Fig. 2 참조). 검출 모델의 정확도를 향상하기 위해 인간의 시각 체계의 수용영역에 대한 부분을 모사하여 응용한 수용 영역 블록(Receptive Field Block, RFB)을 사용하였다. 인간의 시각체계는 한 번에 모든 자극을 수용하는 대신 일정한 범위의 수용 영역을 두고 그 수용 영역 안과 밖의 반응 강도를 다르게 하여 주변 환경을 시각적으로 지각한다. 여기에서 영감을 얻은 RFB는 다양한 크기의 필터와 필터의 크기에 따른 팽창률(dilation rate)을 가지는 합성곱층으로 구성된다(Liu and Huang, 2018). 본 논문에서는 이러한 RFB를 사용하여 피라미드 형태의 필터 구성을 갖는 네트워크 모듈을 설계하여 넓은 영역을 효율적으로 탐색하면서 파라미터의 숫자를 줄여 연산량을 감소시키었다(Fig. 3 참조).

2.3 k-근접 이웃을 사용한 조립성능 평가 기법

본 논문에서는 k-근접 이웃(k-Nearest Neighbor, kNN)기반의 앙상블 모델을 사용하여 조립 성능(조립가능 여부)을 평가하고자 하였다. 앞에서 언급된 딥러닝 네트워크 모델을 적용하여 조립부를 판단하고, 볼트홀의 위치를 추정한다. 추정된 볼트홀의 위치를 바탕으로 양・불량을 판단하며, 판단 알고리즘으로 k-근접 이웃 기법을 적용하였다. k-근접 이웃은 단순하지만 효율적인 분류 모델을 구축하기 위한 기계학습 알고리즘이다.

기계학습은 특정한 목표를 위하여 수집된 데이터셋을 기반으로 데이터의 경향이나 분포를 학습하여 모델을 구축하고 그 성능을 측정할 수 있는 지표를 사용하여 특정한 목표에 맞게 성능을 향상시키는 과정을 의미한다(Michalski et al., 2013). 이러한 기계학습은 목표로 하는 구체적인 수치나 정의된 분류 범위가 존재하는지에 따라 지도 학습과 비지도 학습으로 분류된다. 지도 학습의 경우 데이터셋에 목표로 하는 연속적인 값이나 구체적인 분류 기준이 존재하는 학습방법으로 모델을 통해 예측되는 값과 목표 값의 차이를 사용하여 학습을 수행하게 된다. 비지도 학습의 경우 구체적인 목표 값이 없으므로 데이터셋 내부의 경향을 학습하거나 분포에 따른 분류를 수행하는 방식으로 학습을 진행하게 된다. 지도 학습은 데이터셋에 존재하는 목표 값의 유형에 따라 회귀와 분류 문제로 나누어진다(Géron, 2019). 회귀의 경우 데이터셋의 목표 값이 연속적인 수치로 구성되는 경우로 가격이나 정도 등 특정한 수치를 구하기 위한 용도로 사용된다. 분류의 경우 데이터셋의 목표 값이 범주화 된 값인 경우로 양・불량 판단이나 합격판정 등의 문제에 적용된다.

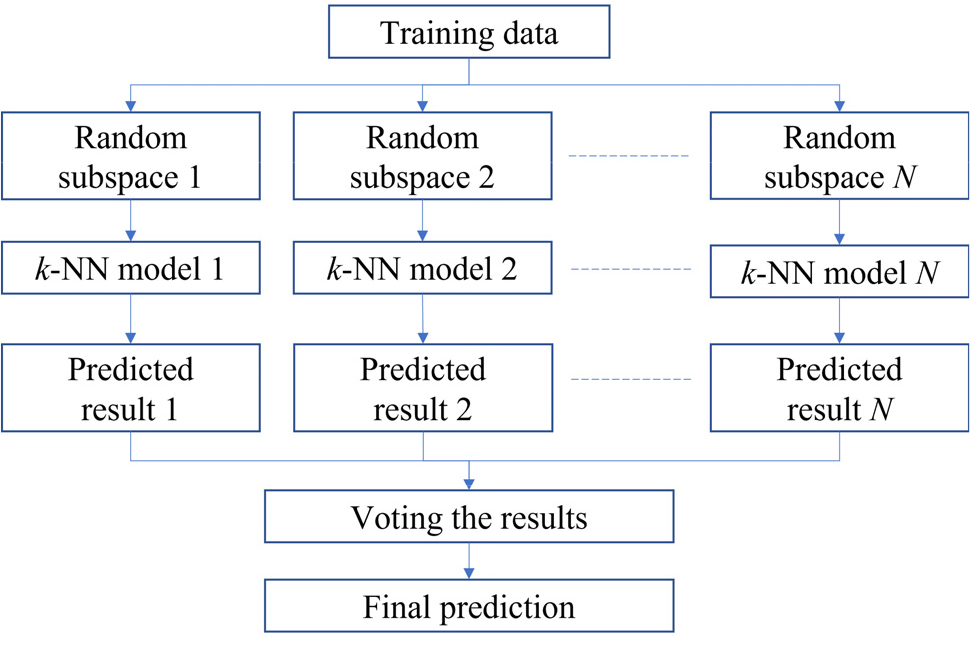

k-근접 이웃이 데이터를 분류하는 방법은 각각의 개별적인 데이터들 사이의 거리를 계산하고 그 거리를 바탕으로 k개의 가장 가까운 범위안에 있는 데이터들을 분석하여 데이터를 분류한다(Peterson, 2009). 따라서 학습을 통해 수치적인 모델을 구축하기보다는 연속적으로 데이터를 저장하고 저장된 데이터를 바탕으로 입력되는 데이터들에 대한 연산을 수행하여 분류를 수행하게 된다. 따라서 데이터가 많아질수록 모델의 성능이 향상되지만 동시에 연산량이 많아지는 문제가 발생하게 된다(Ma et al., 2021). 이러한 문제를 해결하고 더 많은 데이터를 효율적으로 사용하여 분류 모델을 구축하기 위하여 부분 공간 기법을 포함한 앙상블 모델을 적용하였다. 부분공간은 전체 데이터를 모두 사용하는 대신 일부의 데이터만을 추출하여 사용하는 개념으로 다수의 데이터 셋을 구축할 수 있다는 장점이 있다(Ho, 1998). 부분 공간을 적용하는 경우 Fig. 4와 같이 다수개의 부분공간에서 k-근접 이웃 기법을 사용하여 판별된 예측 결과들 중 가장 좋은 성능을 보이는 결과를 투표(Voting)하여 결정한다.

3. 실험 및 검증

3.1 3D 축소 모형을 이용한 실험 환경 구축

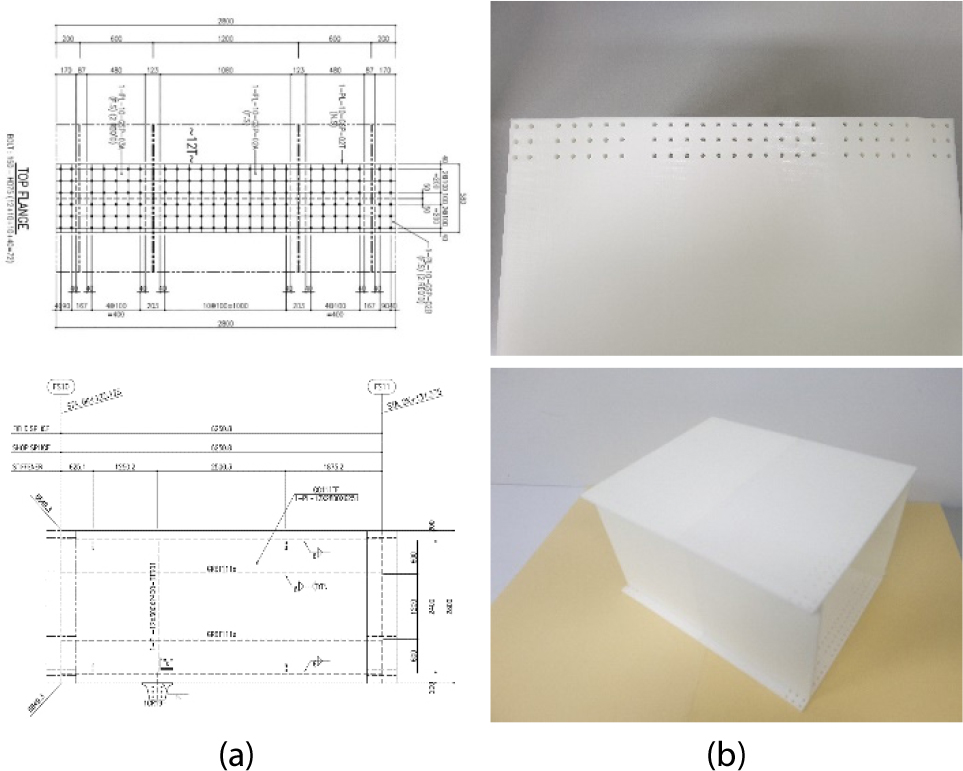

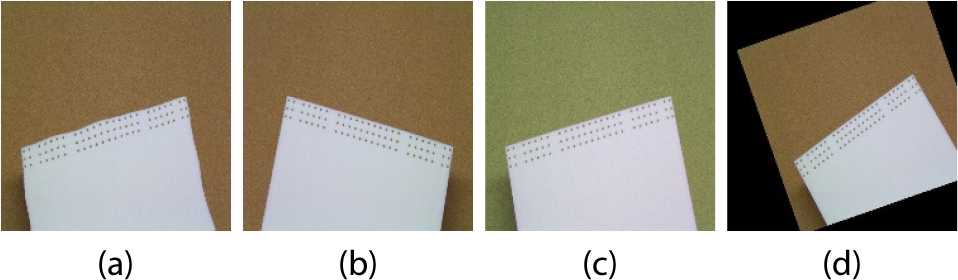

제안된 조립 성능 평가 기법을 검증하기 위해 공장에서 생산되는 프리팹 강구조물의 도면(Fig. 5 참조)을 참고하여 학습 및 검증용 3D 프린팅 모형을 제작하였다. 실제 크기의 1/10 크기로 축소하여 모형을 제작하였고 모든 모서리의 조립부에 정상적인 형태의 볼트홀과 서로 다른 패턴의 불량 형태를 가지는 볼트홀을 타공하여 최대한 많은 데이터의 수집이 가능하게 하였다. 불량의 경우 국토교통부의 도로교 표준시방서에서 규정하는 볼트 그룹 내 양끝단의 허용 거리 오차인 2mm를 고려하여 1/10 스케일을 반영한 0.2~0.3mm 간격 내 오차를 상하 및 좌우 방향에 적용하여 제작하였다(Ministry of Land, Infrastructure and Transport in Korea, 2013).

볼트를 사용하여 결합하는 프리팹 강구조물을 조립성능 평가의 대상으로 하였으며, 국토교통부의 도로교 표준시방서에서 규정한 내용인 볼트 구멍의 허용 오차를 비롯한 관통율, 정지율을 점검하기 위해서는 조립시 볼트홀 위치의 정합성이 가장 중요한 요소로서 고려되어야 한다고 판단하여 볼트홀의 위치를 추출하여 이를 바탕으로 기계학습을 위한 매개변수를 설정하였다.

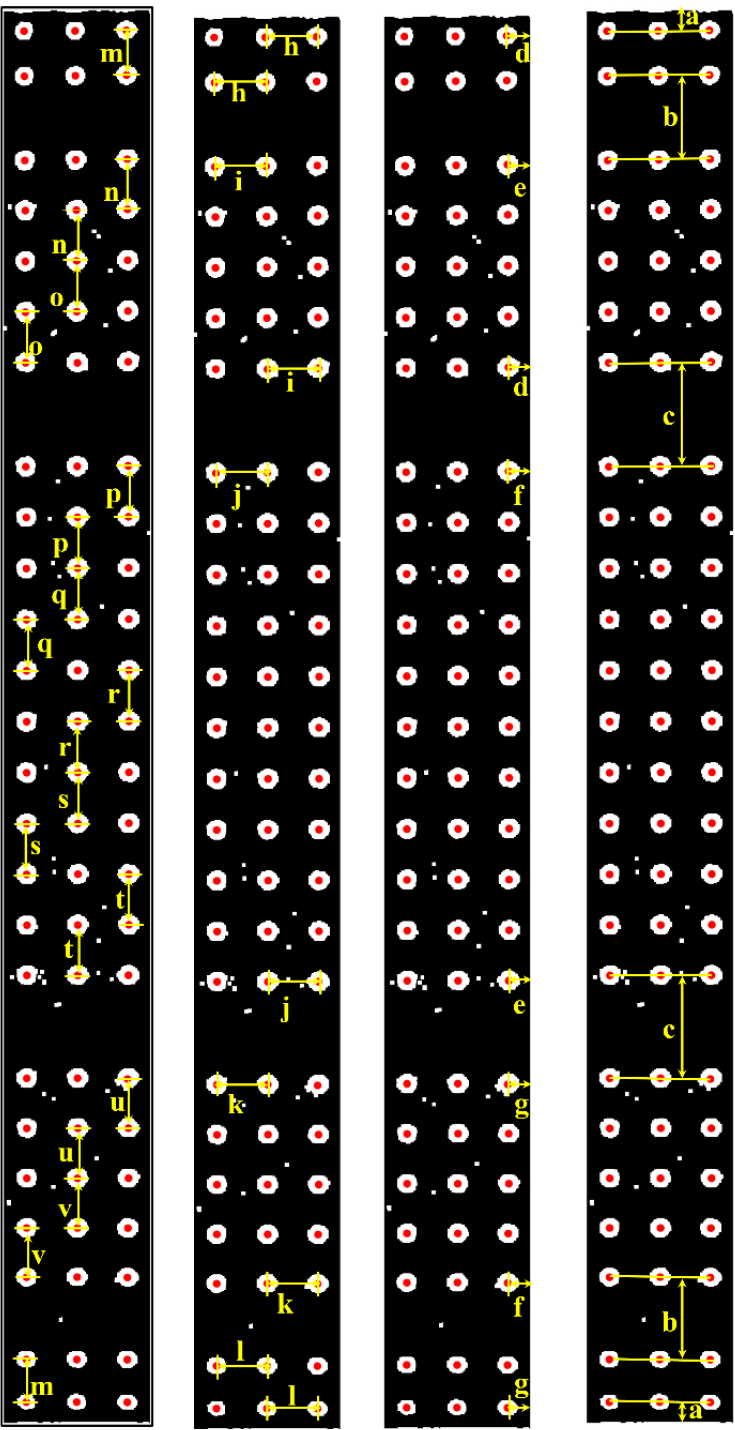

양・불량 판정을 위한 기계학습 모델 학습을 위한 매개변수는 Fig. 6와 같이 볼트 홀 사이의 종횡방향의 거리의 비로 계산하였다. 비전 센서를 사용하여 영상을 수집하는 경우, 촬영 거리 혹은 각도의 영향으로 볼트홀 사이의 거리, 즉 픽셀값이 프레임마다 달라질 수 있으므로 길이의 비율을 계산하여 촬영 상황이 변경되어도 같은 값을 갖도록 하였다. 자세히는, 그림에서와 같이 각각의 알파벳이 표기된 부분의 길이의 비율을 계산하고, 도면상의 값과의 차이를 계산하여, 총 22개의 파라미터를 산정하였다.

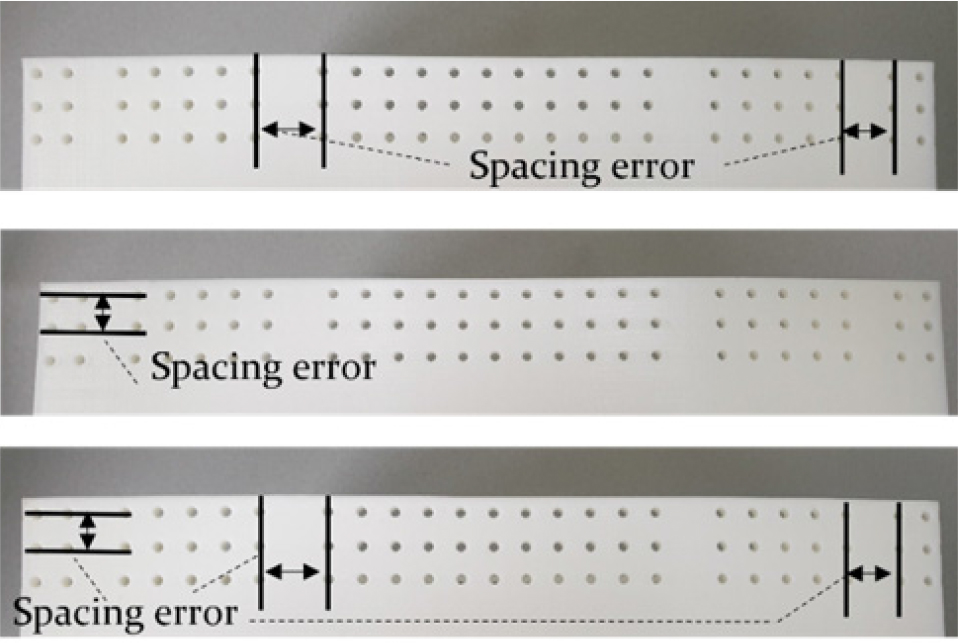

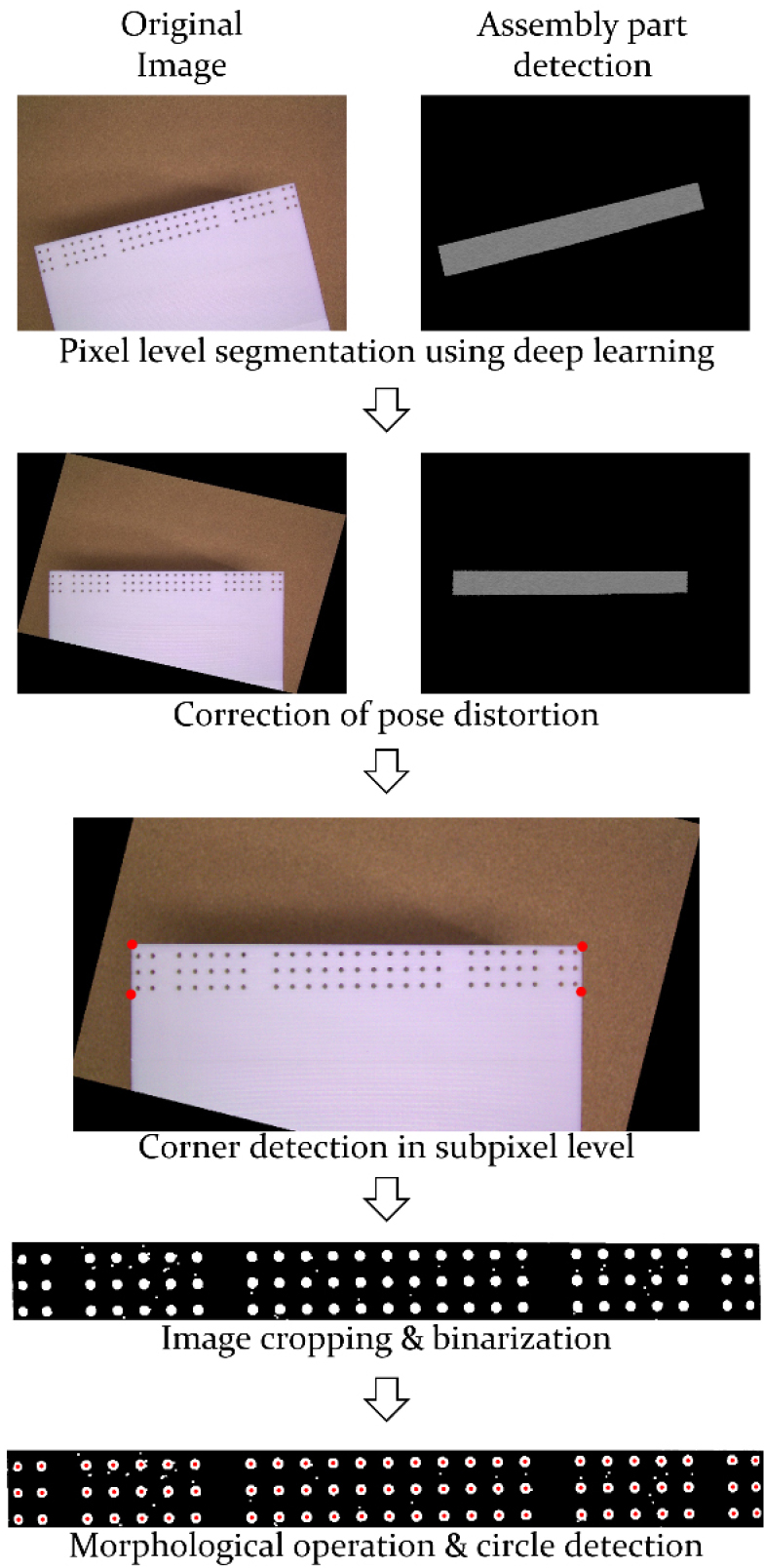

프리팹 구조물의 조립부 제작시 발생 가능한 불량을 조사하였고 Fig. 7과 같이 3가지의 대표적인 불량 유형을 설정 및 제작하였다. 조립부 내부의 볼트홀의 중심 좌표를 구하기 위해서 다양한 영상처리 기법이 사용되었다(Fig. 8 참조). 먼저 영상의 각도를 보정해 줌으로써 검출된 조립부가 영상의 정중앙에 위치하도록 영상을 보정하였으며, 조립부의 모서리는 최소 고유값 알고리즘(Minimum eigenvalue algorithm)을 탐색하였다. 이후 조립부의 실제 크기에 맞추어 좌표 변환을 수행하여 보정하였다. 보정된 영상 내, 그래디언트(Gradient) 영상 추출, 캐니(Canny) 엣지 검출기를 활용한 흑백영상 변환, 모폴로지 침식 연산을 사용한 볼트홀 강조, 허프(Hough)변환을 이용한 원형 물체 검출을 이용하여 볼트 홀의 위치를 계산하였다.

부분 공간을 사용한 k-근접 이웃의 앙상블의 경우 전체 데이터에서 임의로 데이터를 추출하고 이를 바탕으로 약한 학습기를 여러 개 만들어 그 결정을 종합하여 최종적인 조립 성능에 대한 판단을 하는 방법을 사용하였다. 데이터를 임의로 추출하여 50개의 부분공간을 만들고 예측을 수행하였다.

3.2 조립부 검출 및 성능 예측 실험 결과

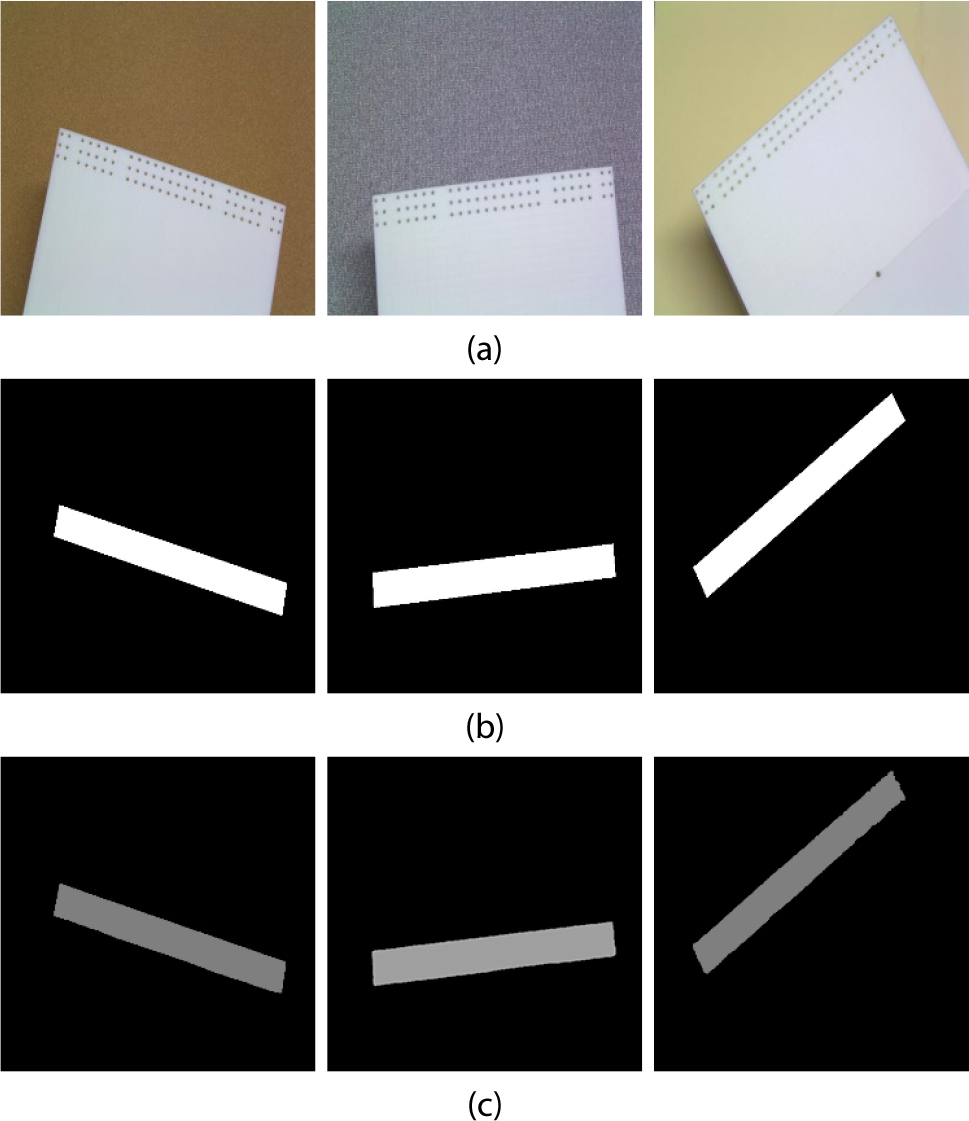

제작된 3D 모형을 비전센서(Basler사 acA3800-14uc모델, 해상도 3840×2748)를 사용하여 촬영하고 데이터셋을 구성하였다. 300장의 영상을 촬영하였고 정상 조립부 60개와 불량 조립부 240개로 구성되었다. 구성된 원본 데이터셋에서 20%의 데이터인 60개(정상 12, 불량 48개)를 분류하여 구축된 조립부 검출 및 조립성능 평가 모델의 검증을 위해 사용하였다. 딥러닝 네트워크의 성능 향상을 위하여 탄력적 변형(elastic distortion), 좌우 변환, 색상 수정, 기하학적(affine) 변환 방법을 적용하여 데이터 부풀리기를 수행하였다(Fig. 9 참조). 탄력적 변형의 경우 라벨링된 조립부의 관심 영역을 사용하여 조립부에 탄성적 왜곡을 주었고 색상 수정의 경우 색상 외에도 채도, 명도, 밝기 등 색에 관계되는 모든 요소를 임의로 변경하였다. 기하학적 변환은 영상의 크기와 각도 및 위치 이동을 포함하였다.

조립부 검출을 위한 딥러닝 모델 구축을 위한 딥러닝 프레임워크로 파이토치(Pytorch)를 사용하였고, 학습을 위한 배치 사이즈(batch size)는 3, 전체 데이터 세트를 학습하는 에포크 (epoch)를 500으로 설정하여 반복하였다. 테스트 수행 결과의 성능은 모든 테스트를 위한 데이터셋에서 라벨링한 참값과 네트워크에 의해 출력된 예측값에서 겹치는 부분을 각각 계산하여 평균을 구한 IoU(Intersection over Union), 정밀도(Precision)와 재현율(Recall)의 조화평균(F1 score)으로 평가하였다. 그 결과 제안된 네트워크의 IoU와 조화평균이 각각 96.5%, 98.2%이었으며, 개발된 RFB기반 네트워크를 사용하여 세분화한 결과는 Fig. 10(c)와 같다.

검출된 조립부를 바탕으로 부분공간을 활용한 k-근접 이웃 기법을 사용한 앙상블 모델을 사용하여 조립 성능을 정상과 불량으로 분류하였다. 앙상블 모델의 경우 부분공간의 데이터를 추출하고 k-근접 이웃을 계산하는 모델 생성을 50회 반복하여 그 결과를 종합하는 방식을 사용하여 구축하였으며, 유클리드 거리를 계산하여 데이터 간의 거리를 구하였고 하나 이상의 근접 이웃을 찾아 분류를 수행하도록 설정하였다. 앙상블 모델의 학습을 위한 매개변수의 추출을 위해서는 라벨링된 마스크가 사용되었고 검증용 매개변수의 추출을 위해서는 제안된 딥러닝 네트워크의 조립부 검출 결과를 활용하였다. 그 결과 96.6%의 판별 정확도를 보였다.

4. 결 론

본 연구에서는 프리팹 강구조물의 생산 과정 중 가조립 단계의 단순화를 위한 비전센서와 머신러닝 알고리즘을 사용한 조립 성능 평가 기법을 제안하였다. 제안된 기법은 두 가지 단계로 구성된다. 첫 번째 단계는 딥러닝 기반의 물체 세분화(Instance segmentation) 네트워크를 사용하여 조립부를 검출하는 단계이다. 물체 세분화 네트워크의 성능 개선을 위해 수용 영역 블록(RFB)에 기반한 모듈을 구축하여 활용하였다. 두번째 단계는 검출된 조립부에서 매개변수를 추출한 후 기계학습 기반의 조립 성능 판별 모델을 사용하여 조립 성능을 정상과 불량으로 분류하여 판별하는 단계이다. 검출된 조립부를 대상으로 영상처리를 통해 판별 모델의 입력을 위한 매개변수를 추출하였고, 추출된 매개변수를 부분공간을 사용한 k-근접 이웃 기법의 앙상블 모델을 사용하여 학습 후 판별에 사용하였다. 매개변수는 조립부의 볼트홀 위치와 프리팹 강구조물의 CAD 도면을 활용하여 정의하였다. 도면을 바탕으로 제작된 3D 프린팅 축소 모델을 촬영하고, 조립부 검출을 위한 딥러닝 네트워크와 기계 학습을 사용한 조립 성능 판별 기법을 검증하였다. 그 결과 검출 IoU가 96.5%로 거의 대부분의 조립부를 픽셀 단위로 검출하였고 판별 정확도 역시 96.6%의 성능을 보여 주어 각각 5%미만의 오차를 보이는 것을 확인할 수 있었다.

향후에는 도로교 표준시방서에서 규정하는 솟음에 대한 허용 오차를 고려하여 정상 및 불량 판별이 가능한 알고리즘의 개발과 조립 성능 판별을 위한 매개변수의 단순화에 대한 연구를 진행하고자 한다. 또한, 실제 규모의 프리팹 구조물에 적용하기 위하여 모바일 플랫폼을 이용한 실물 프리팹 구조물의 근접 촬영, 분할되어 촬영된 영상의 통합, 영상 내 딥러닝 기반의 조립부 검출 및 성능 평가가 가능한 통합시스템 개발을 수행하고자 한다.