1. 서 론

20세기 이후로, 세계적으로 해상 물동량이 증가함에 따라(Kim et al., 2010), 이를 뒷받침하기 위하여 선박의 대형화 및 고속화로 건조기술이 발전하였고, 이에 따라 대형선박을 제어할 수 있는 항해 기술 또한 발전하게 되었으며, 대형선박의 항해를 지원할 수 있는 장비 및 시스템이 등장하였다.

초기의 항해 지원장비 및 시스템으로 국제수로기구(IHO: International Hydrographic Organization)에서 해양분야 데이터 처리를 위하여 제정된 데이터 표현에 관한 국제표준 S-52와 전자해도(ENC: Electric Navigation Chart) 제작에 관한 국제표준 S-57을 기반으로 종이 해도를 전자화한 전자해도와 전자해도표시 시스템(ECDIS: Electric Chart Display and Information System)이 도입되었고, 안전항해에 있어서 획기적인 기여를 하였다.

최근에는 국제해사기구(IMO: International Maritime Organization)에서 해양안전과 해양환경 보호를 목적으로 차세대전자항법체제(e-Navigation)를 도입하고자 하고 있다. 이에 따라 해상과 육상의 다양한 정보를 통합하고 활용하는데 있어 기존의 국제표준인 S-57의 데이터 처리 표준으로는 한계가 발생하여 이를 극복하기 위한 해양데이터 처리 표준인 S-100을 개발하였으며, 세부 표준인 S-10x가 새로운 전자해도의 기준으로 전환될 것으로 전망하고 있다.

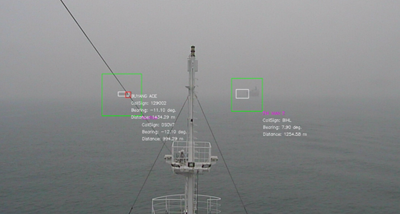

본 연구에서는 S-10x 기반의 항행정보 가시화를 위한 연구로써, 현재 증강현실 기반의 항행정보 가시화 시스템을 연구 개발 중(Lee et al., 2013)에 있으며, 이를 Fig. 1에서 보이고 있다. 기존 사용되고 있는 항행장비의 경우, 항해사가 레이더 혹은 전자해도표시 시스템을 이용하여 해상의 물체를 확인한 뒤, 해상상황을 육안으로 직접 파악하여 운항하였다면, 증강현실 기반의 항행정보 가시화 시스템은 선교에 설치된 CCTV로부터 전달받은 영상에서 물체를 인식한 후, 물체의 위치에서 항행장비로 획득한 정보를 가시화하여 효과적인 항행을 할 수 있도록 지원한다. 현재 연구개발 중인 증강현실 기반의 항행정보 가시화 시스템은 기존 항행 장비에 탑재되어 항행을 지원할 경우, 항해사의 시선은 아래로 향하여 해상상황을 육안으로 확인하지 못하는 상태에 놓이게 된다.

본 연구에서는 이를 방지하고자 증강현실 기반의 항행정보 가시화 시스템을 효과적으로 표출하여 항해사에게 지원할 수 있는 방안으로, 선교(bridge) 창을 통한 외부모습과 증강현실 기반의 항행정보 가시화 시스템에서 표출되는 항행정보를 동시에 확인할 수 있는 HUD(Head Up Display)의 투명 디스플레이에 적용하는 방안을 고려하였다. 투명 디스플레이는 일반 LCD모니터와 다르게 모니터 후면이 그대로 투영되어 보이고, 투영된 모습(투영 이미지)은 사용자의 위치에 따라 다르게 보이는 특징을 갖는다. 따라서 투명 디스플레이를 적용함에 따라 발생하는 문제점을 해결할 수 있는 시계(parallax)에 대한 영상정합 기술에 대해 연구를 진행하였다.

2. 연구 동향

증강현실 기반의 항행정보 가시화 시스템을 투명 디스플레이에 적용하기 위한 연구를 진행하기에 앞서 투명 디스플레이에 관한 연구 및 개발사례를 조사하였으며, 대표적인 사례를 소개하고자 한다.

2.1 가상 투명화 시스템

조지아 공과대학교(georgia institute of technology)에서는 증강현실을 접목하기 위하여 태블릿(tablet)과 두 개의 카메라를 이용하여 가상 투명화를 구현하였으며, Fig. 2에서 보이고 있다(Hill et al., 2011).

두 대의 카메라를 각각 태블릿 디스플레이의 뒷면과 전면에 부착하여 각각의 카메라로부터 사용자의 시선에 가려지는 부분의 영상을 획득하고, 사용자의 얼굴을 추적할 수 있도록 함으로써 태블릿 디스플레이가 투명 디스플레이처럼 작동할 수 있는 시스템을 개발하였다.

2.2 투명 디스플레이를 이용한 공동 증강현실 시스템

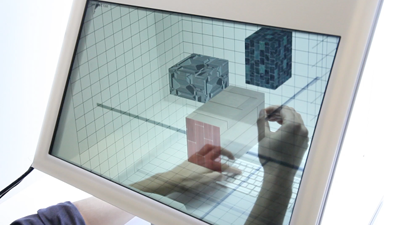

시마네 대학교(shimane university)에서는 사용자 간의 아이디어 교환 및 현실 세계의 객체를 통해 서로 간 보조를 맞출 수 있는 공동 증강현실 시스템을 개발하였다(Hirakawa et al., 2004).

투명 디스플레이에서 표출되는 인터페이스를 제어하기 위하여 사용자의 위치와 몸짓(gesture)을 인식하는 카메라와 현실 세계에서 사물의 위치를 인식하는 카메라, 투명 디스플레이를 구현하기 위한 빔 프로젝터와 투명 아크릴로 구성하였으며, Fig. 3과 같이 투명 디스플레이에 투영되어 보이는 사물에 대하여 의견을 공유할 수 있도록 연구를 진행하였다.

2.3 투명 디스플레이를 이용한 공동 증강현실 시스템

매사추세츠 공과대학교(massachusetts institute of technology)에서는 2D 및 3D 공간의 상호 작용에 대한 융합 개념으로 SpaceTop을 개발하였으며(Lee et al., 2013), 이를 Fig. 4에서 나타내고 있다.

작업 공간인 투명 디스플레이의 2D 공간 및 사용자의 손동작이 표현되는 3D 공간 사이의 원활한 전환을 가능하도록 하는 상호작용 및 시각화 기술을 통해 하이브리드 작업 공간과 이를 가능하도록 하는 하드웨어 및 소프트웨어 구성을 소개하였다.

대부분의 연구에서 투명 디스플레이를 활용한 증강현실 연구가 진행되었다. 하지만 본 연구에서 다루고자 하는 투명 디스플레이를 활용한 증강현실 기반의 항행정보 가시화 시스템과 같은 안전을 위한 가시화 시스템의 개발은 미흡한 실정이다. 따라서 본 논문에서는 항행정보를 투명 디스플레이에서 가시화할 수 있도록 하는 선행연구로써 CCTV에서 획득한 영상과 투영 이미지의 정합이 이루어질 수 있는 사용자의 위치에 대한 시계 정합과 영상보정에 대해서 다루고자 한다.

3. 투명 디스플레이에서의 시계 정합 및 영상보정

투명 디스플레이에서의 항행정보 가시화의 의미는 선교에 설치된 CCTV를 통하여 입력되는 영상을 시계 정합 및 영상 보정을 통해 가공된 영상 위에 항행정보를 덧입혀 투명 디스플레이의 투영 이미지와 일치하도록 표출하는 것을 의미한다. 투명 디스플레이에 증강현실 기반의 항행정보를 가시화하기 위한 시계 정합 및 영상보정에 대해 소개하고자 한다.

3.1 영상 왜곡 및 카메라 보정

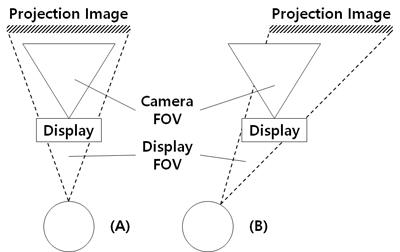

본 연구에서는 투영 이미지를 사용자가 투명 디스플레이를 통하여 보이는 모습으로 정의한다. 투영 이미지는 사용자가 투명 디스플레이를 어느 각도에서 바라보는지에 따라 변하기 때문에 CCTV를 통해 획득한 영상을 디스플레이에 표출하는 데 한계가 발생하며, 이러한 한계를 Fig. 5에서 나타내고 있다. 사용자의 위치에 따라 투명 디스플레이에서 보이는 투영 이미지의 변화와 영상을 획득하기 위한 카메라의 화각의 관계에 대해 나타내고 있다. 일반적으로, 카메라의 렌즈를 일반 렌즈로 사용하여 획득한 영상을 디스플레이에 표출하는 경우, 사용자가 디스플레이의 중심으로부터 상·하·좌·우로 일정 각도를 벗어나게 되면 출력되는 영상범위에서 벗어나게 된다. 즉, 디스플레이에 표출되는 영상의 일부가 보이지 않음을 의미한다. 따라서 이를 해결하기 위하여 일반렌즈를 사용하지 않고 광각렌즈를 사용함으로써 더 넓은 범위의 영상을 획득하여 이러한 현상을 보완하고자 하였다. Fig. 6은 일반 렌즈를 사용한 카메라의 화각과 사용자의 투명 디스플레이에 대한 화각과의 관계와 광각렌즈를 사용한 카메라의 화각과 사용자의 투명 디스플레이에 대한 화각의 관계를 비교하여 나타내고 있다. 그러나 광각렌즈를 사용할 경우에는 CCTV를 통하여 획득한 영상이 방사형 왜곡을 갖게 되어 이를 해결하기 위하여 카메라 보정(calibration)을 수행하였다. 카메라 보정을 위하여 보편화된 왜곡보정 식을 사용하였으며, 다음과 같이 표현된다(Zhang et al., 2000).

여기서, x, y는 이미지 상에서의 좌표를 나타낸다. A는 카메라의 행렬(matrix)인 카메라의 내부요소(intrinsic parameter)를 의미하며, fx,fy는 카메라의 초점 거리(focal length), cx,cy는 주점(principal point), skewc는 비대칭 계수(skew coefficient)를 포함하고 있다. X, Y, Z는 월드 좌표계(world coordinate system) 상의 3차원 공간 좌표를 의미하고 [R|t]는 월드 좌표계를 카메라 좌표계(camera coordinate system)로 변환시키기 위한 회전 및 이동변환 행렬을 의미한다.

3.2 카메라 영상과 투명 디스플레이의 시계 정합

투명 디스플레이에 항행정보를 가시화하기 위해서는 사용자가 디스플레이를 바라보는 각과 카메라를 통해 획득된 영상 간 정합은 필수적이다. 투영 이미지는 사용자와 투명 디스플레이 사이의 거리와 사용자가 디스플레이를 바라보는 각도에 따라 달라지며, 세부적인 내용은 다음과 같다.

3.2.1 거리에 따른 시계 정합

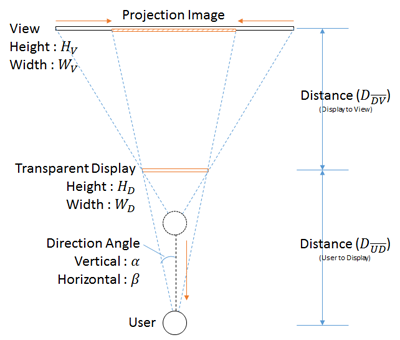

사용자와 투명 디스플레이 사이의 거리에 따라 투명 디스플레이를 통해 보이는 투영 이미지를 계산하기 위해서는 우선적으로 기준 시계에 대한 계산이 이루어져야 한다. 기준 시계는 카메라의 중심과 투명 디스플레이의 중심이 일치한다고 가정하였을 때, 사용자의 디스플레이에 대한 화각으로 수직각과 수평각을 의미한다. 이는 카메라로부터 일정거리 떨어진 위치에서 획득되는 영상에 보이는 실제 높이/폭과 영상에서의 높이/폭(또는 실제 물체의 높이/폭과 영상에서의 물체의 높이/폭), 사용자와 투명 디스플레이 사이의 거리를 이용하여 구한 수직각과 수평각을 나타낸다. 따라서 거리에 따른 기준 시계에 대한 계산은 다음과 같이 표현되며, 개요를 Fig. 7에서 나타내고 있다.

여기서, α, β는 각각 수직각과 수평각을 의미하고, HD, WD, HV, WV는 각각 투명 디스플레이의 높이와 폭, 투영 이미지의 실제 위치에서의 높이와 폭을 의미한다.  ,

,  는 각각 사용자와 투명 디스플레이 사이의 거리, 투명 디스플레이와 투영 이미지의 실제 위치까지의 거리를 의미한다. 이를 통해 사용자와 투명 디스플레이 사이의 현재 거리를 이용하면 거리에 따른 영상 표출 범위를 계산할 수 있으며, 다음과 같이 도식화할 수 있다.

는 각각 사용자와 투명 디스플레이 사이의 거리, 투명 디스플레이와 투영 이미지의 실제 위치까지의 거리를 의미한다. 이를 통해 사용자와 투명 디스플레이 사이의 현재 거리를 이용하면 거리에 따른 영상 표출 범위를 계산할 수 있으며, 다음과 같이 도식화할 수 있다.

여기서, OIH,OIW는 각각 표출 영상의 높이와 폭을 의미한다.

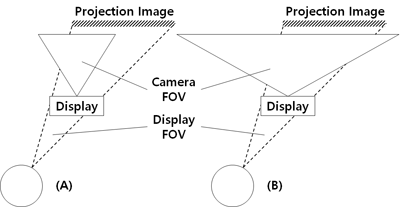

3.2.2 위치에 따른 시계 정합

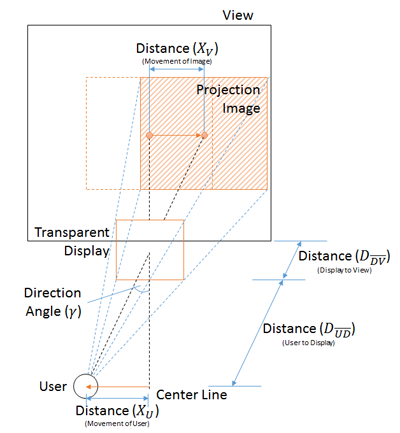

사용자의 위치는 거리와 다르게 방향성을 갖는다. 사용자가 투명 디스플레이를 바라보는 방향에 따라 투영 이미지가 달라지므로 카메라를 통해 획득된 영상에서 디스플레이에 표출하고자 하는 투영 이미지를 계산하게 된다. 사용자의 위치에 대해 표출되는 영상의 위치를 계산하기 위한 개요를 Fig. 8에서 보이고 있으며, 이를 이용해 표출되는 영상의 위치를 도식화화여 다음과 같이 나타낼 수 있다.

여기서, γ는 사용자가 디스플레이를 바라보는 각을 의미하며, XU,  는 각각 투명 디스플레이의 중심에서 나오는 가상의 선에서 수직으로 떨어진 사용자와의 거리와 사용자와 투명 디스플레이 사이의 거리를 의미한다. XV는 View 중심에서 투영 이미지 중심까지의 거리를 의미하고,

는 각각 투명 디스플레이의 중심에서 나오는 가상의 선에서 수직으로 떨어진 사용자와의 거리와 사용자와 투명 디스플레이 사이의 거리를 의미한다. XV는 View 중심에서 투영 이미지 중심까지의 거리를 의미하고,  는 투명 디스플레이와 View 사이의 거리를 의미한다.

는 투명 디스플레이와 View 사이의 거리를 의미한다.

4. 시스템 구성

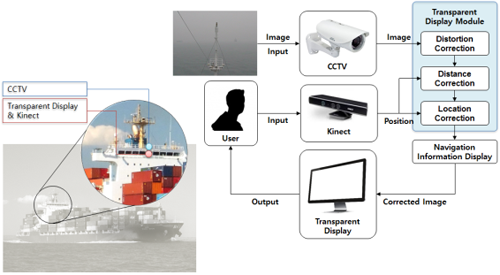

본 논문에서 제안하고자 하는 투명 디스플레이를 적용한 증강현실 기반의 항행정보 가시화 시스템의 구성은 Fig. 9와 같이 입․출력을 위한 장비와 투명 디스플레이 모듈, 항행 정보 가시화 모듈로 구성되어 있다.

입·출력을 위한 장비로는 선교 상단에 설치되어 해상상황을 영상으로 입력받는 CCTV와 선교 내부에 설치되어 사용자의 위치를 인식하기 위한 키넥트 센서(kinect sensor), 선교 내부에 또한 설치되어 사용자에게 항행정보를 가시화하여 표출하기 위한 영상 출력 장비인 투명 디스플레이로 구성되어 있다.

키넥트 센서는 적외선 레이저 빔 프로젝터와 단색 CMOS 센서를 통해 깊이 정보 추출방법을 사용하여 사람의 움직임을 추출할 수 있는 장비로, 적외선 레이저 빔이 비춰지면 반사된 레이저 빔 포인트를 CMOS 센서가 받아서 각 픽셀당 거리가 측정되고, 이들 데이터를 이미지 프로세서가 처리하여 키넥트 센서 앞 사용자의 3차원 정보를 인식하여 사용자의 위치를 획득하게 된다.

선교 상단에 설치된 CCTV를 통해 입력된 영상은 투명 디스플레이 모듈에서 왜곡보정이 수행된다. 왜곡보정이 수행된 영상은 키넥트 센서의 머리 추적(head tracking)을 통하여 입력받은 사용자의 위치에서의 거리와 위치에 대하여 각각의 보정이 수행된다. 투명 디스플레이에 대한 보정이 수행된 후에 현재 개발 중인 항행정보 가시화 시스템을 통하여 항행정보를 가시화하고, 최종적으로 투명 디스플레이에 영상을 표출하여 사용자에게 전달하게 된다.

5. 시스템 구현

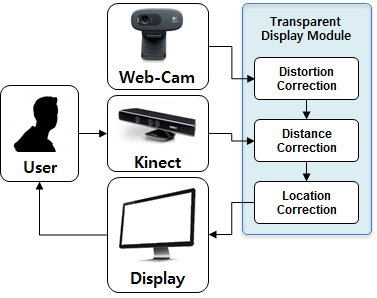

본 연구에서는 증강현실 기반의 항행정보 가시화 시스템에 투명 디스플레이 적용을 위한 시스템을 구현하기에 앞서, 일반 LCD 모니터와 카메라(web-cam), 키넥트 센서를 활용하여 프로토타입으로 가상 투명 디스플레이를 구현함으로써 시스템의 유효성을 입증하고자 하였으며, Fig. 10과 같이 구성하였다.

증강현실 기반의 항행정보 가시화 시스템에 투명 디스플레이를 적용 시, CCTV에 대한 영상 입력장치를 Web-Cam으로 대체하여 사용하였으며, 사용자에게 항행정보를 전달하기 위한 투명 디스플레이에 대한 출력장치로 일반 LCD 모니터로 대체하여 가상의 투명 디스플레이로 구현하였다.

6. 테스트 및 검증

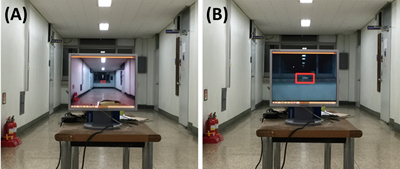

본 연구에서 Web-Cam과 일반 LCD 모니터, 키넥트 센서를 활용하여 프로토타입으로 가상의 투명 디스플레이를 구현하였다. Fig. 11에서는 보정을 수행하여 사용자 위치에 대한 시계 정합을 수행한 결과와 증강현실 기반의 항행정보 가시화 시스템 적용을 위한 물체 검출과정을 가정한 사각형의 검출기 표출에 대한 결과를 보이고 있다. (A)는 사용자의 위치와 무관하게 Web-Cam에 입력되는 이미지 원본을 출력하였고, (B)는 사용자의 위치에 대해 시계 정합을 수행한 결과를 출력하였다. 테스트 결과로, 두 이미지 모두 정면에 존재하는 물체에 대해 추적하는 적색 사각형이 정확하게 표시됨을 확인할 수 있었다. 반면에 두 이미지를 비교해 볼 때, 출력된 이미지는 외부와 정합이 이루어지지 않은 (A)의 경우에는 이질감이 존재하며, (B)의 경우, 사용자의 위치에 대해 외부와 정합이 이루어져 이질감 없이 LCD 모니터로 가려진 부분을 보는듯한 결과를 나타냈다.

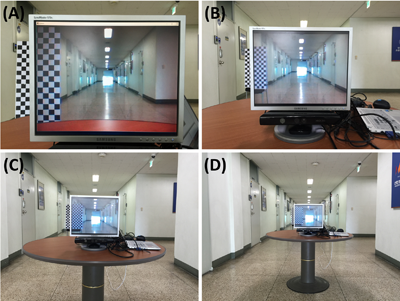

또한 사용자와 디스플레이 사이의 거리와 사용자가 디스플레이를 바라보는 방향에 대한 시계 정합을 수행하였으며, 이를 Fig. 12에서 나타내고 있다. (A)와 (B)는 사용자와 디스플레이 사이의 거리에 따른 시계 정합을 나타내고 있으며, (C)와 (D)는 각각 우측과 좌측에서 디스플레이를 바라본 결과를 나타내고 있다.

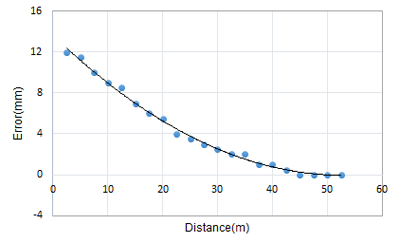

시계 정합에 대한 테스트를 검증하기 위하여 가로 세로 각각 5cm인 정사각형 격자무늬 판을 사용하였으며, 격자무늬 판을 활용한 정확도 판정에 대하여 Fig. 13에서 나타낸다. 시계 정합 수행의 결과로 사용자와 디스플레이 간 거리에 따라서 가까운 거리에 존재하는 물체에 대한 정합도는 상당한 오차를 보였다. 다만, 거리가 멀어질수록 물체에 대한 정합도는 점차 높아진 것을 보였고 원인으로는 Web-Cam의 위치 및 화각으로 판단되었다. Web-Cam의 위치가 사물과 가까울수록 영상에서 물체의 크기는 크게 보이기 때문에, 이 부분에 대한 오차라고 판단된다. 이 오차는 물체 인식에 대한 오차로 실제 보이는 격자무늬의 가로·세로 길이와 화면에서 보이는 격자무늬의 가로·세로 길이의 차이로 계산하였다. 오차를 거리에 따라 비교하였을 때, 거리가 가까울수록 사물에 대한 오차율은 커지고 일정 거리 이후에는 오차가 거의 없는 것을 판단할 수 있으며, Fig. 14와 같은 결과를 보인다.

프로토타입의 테스트를 수행한 결과로, 비교적 먼 거리에서는 정합도가 높으므로 해상 선박을 감지하고 그에 대한 정보 표출하는 증강현실 기반의 항행정보 가시화 시스템의 투명 디스플레이에서의 적용 가능성을 확인하였다.

7. 결론 및 향후 연구계획

본 연구에서는 증강현실 기반의 항행정보 가시화 시스템을 효과적으로 지원하기 위한 방안으로 투명 디스플레이에 가시화하기 위한 연구를 진행하였다. 투명 디스플레이 적용에 대한 가능성을 검증하기 위해 Web-Cam과 키넥트 센서, 일반 LCD모니터를 활용하여 가상의 투명 디스플레이를 구현하고 가상의 투명 디스플레이 내에서 물체 감지를 통한 프로토타입 테스트를 진행하였다. 그 결과, 투명 디스플레이에서의 증강현실 기반의 항행정보 가시화 시스템의 적용 가능성을 확인하였다. 또한 테스트 진행을 통한 개선사항을 도출하였다.

시계 정합의 정확성 향상과 실 적용될 CCTV 영상의 처리 속도에 대한 연구가 필요하다. 사물의 위치에 따라 가까운 거리와 일정 이상 떨어진 거리에 대한 정합도를 향상시키기 위한 거리 정합이 필요하며, 해상도가 낮은 영상일수록 영상의 왜곡보정의 정확도가 떨어져 이에 대한 오차가 발생하기 때문에, 실 적용될 CCTV의 영상을 확보하여 정확도를 향상시킴으로써 이에 따른 고해상도의 영상처리에 대한 방안을 재고할 수 있을 것이다.

앞서 수행한 프로토타입은 본 연구 목표인 투명디스플레이를 활용한 증강현실 기반의 항행정보 가시화 시스템의 선행된 결과로서, 향후 실제 선박에 탑재되는 장비를 통한 테스트와 그에 따라 의도한 결과가 도출될 수 있도록 개선하는 연구가 필요하다.